Machine Learning vs Deep Learning: ¿Cuál Elegir?

Alex Rivera

13 de febrero de 2026

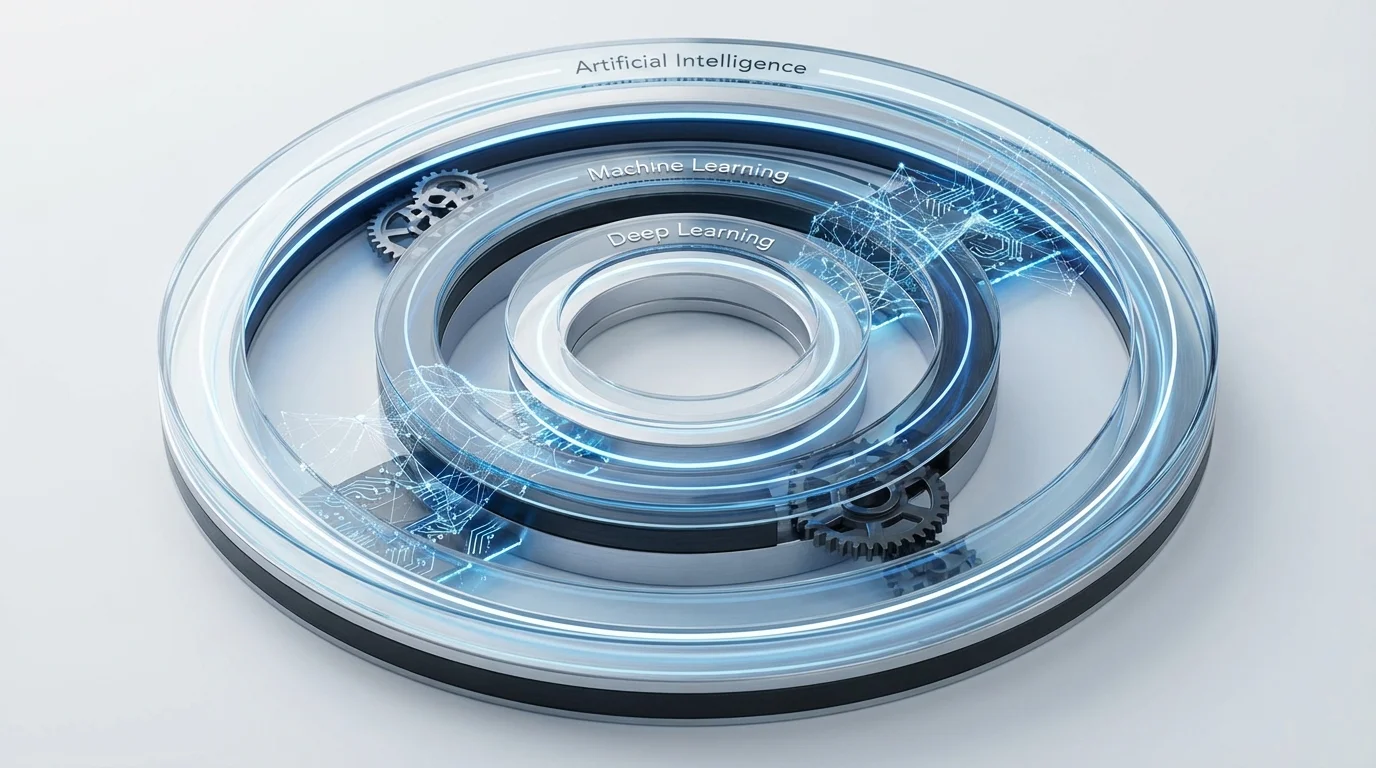

Machine learning y deep learning son dos de los terminos mas utilizados en tecnologia hoy, y a menudo se usan de forma intercambiable — lo cual es un problema, porque no son lo mismo. Deep learning es un subconjunto de machine learning, que a su vez es un subconjunto de inteligencia artificial. Entender la distincion no es solo academico — determina que enfoque es adecuado para un problema dado, cuantos datos y poder computacional necesitas, y que tipo de resultados puedes esperar.

Si eres un desarrollador eligiendo un enfoque tecnico, un lider empresarial evaluando soluciones de IA, o una persona curiosa intentando entender la tecnologia que esta reformando el mundo, esta guia te dara una comprension clara y completa tanto de machine learning como de deep learning — como funcionan, como difieren y cuando cada uno es la herramienta correcta para el trabajo.

El Panorama General: Como ML y DL se Relacionan con la IA

Piensa en estos tres terminos como circulos concentricos. Inteligencia artificial es el concepto mas amplio — cualquier tecnica que permita a las maquinas imitar la inteligencia humana. Machine learning es un subconjunto de IA — especificamente, algoritmos que aprenden de datos sin ser explicitamente programados para cada escenario. Deep learning es un subconjunto de machine learning — algoritmos que usan redes neuronales en capas para aprender de grandes cantidades de datos.

Todo sistema de deep learning es un sistema de machine learning, pero no todo sistema de machine learning usa deep learning. Un filtro de spam que usa un arbol de decision para clasificar correos es machine learning pero no deep learning. Un sistema que analiza radiografias de torax para detectar neumonia usando una red neuronal convolucional es deep learning — y por lo tanto tambien es machine learning.

Esta jerarquia importa porque enmarca la pregunta clave: cuando necesitas la complejidad y el poder del deep learning, y cuando el machine learning mas simple es suficiente o incluso superior?

Machine Learning: Aprendiendo de los Datos

Que Es Machine Learning

Machine learning es un conjunto de algoritmos que permiten a las computadoras aprender patrones de datos y hacer predicciones o decisiones sin ser explicitamente programadas para cada caso especifico. En lugar de escribir reglas como "si el correo contiene estas palabras, es spam", alimentas al algoritmo con miles de ejemplos de correos spam y no spam, y aprende a distinguir entre ellos por su cuenta.

La idea clave detras del machine learning es que para muchos problemas, es mas facil mostrar a una computadora ejemplos de comportamiento correcto que escribir reglas explicitas que cubran todos los escenarios posibles. El lenguaje tiene demasiados matices para reglas escritas a mano. Los patrones visuales son demasiado complejos para describir programaticamente. El comportamiento humano es demasiado variado para predecir con logica simple de si-entonces.

Los Tres Tipos de Machine Learning

Machine learning se divide en tres paradigmas principales, cada uno adecuado para diferentes tipos de problemas.

Aprendizaje Supervisado es el tipo mas comun. El algoritmo se entrena con datos etiquetados — pares de entrada-salida donde la respuesta correcta es conocida. Por ejemplo, le muestras al algoritmo miles de listados inmobiliarios con caracteristicas (metros cuadrados, ubicacion, numero de habitaciones) y el precio real de venta. El algoritmo aprende la relacion entre caracteristicas y precio, y luego predice precios para nuevos listados.

El aprendizaje supervisado sobresale en clasificacion (este correo es spam o no?) y regresion (por cuanto se vendera esta casa?). Los algoritmos comunes incluyen regresion lineal, regresion logistica, arboles de decision, bosques aleatorios, maquinas de vectores de soporte y metodos de gradient boosting como XGBoost.

Aprendizaje No Supervisado trabaja con datos no etiquetados — el algoritmo encuentra patrones y estructura sin que se le diga que buscar. Los algoritmos de agrupamiento reunen puntos de datos similares (segmentacion de clientes, deteccion de anomalias). Las tecnicas de reduccion de dimensionalidad simplifican datos complejos preservando relaciones importantes.

El aprendizaje no supervisado es valioso cuando no sabes que patrones existen en tus datos o cuando etiquetar datos es demasiado costoso o impractico. Los algoritmos comunes incluyen agrupamiento k-means, agrupamiento jerarquico, analisis de componentes principales (PCA) y reglas de asociacion.

Aprendizaje por Refuerzo entrena agentes a tomar decisiones interactuando con un entorno y recibiendo recompensas o penalizaciones. El algoritmo no recibe respuestas correctas — descubre estrategias optimas por ensayo y error. El aprendizaje por refuerzo produjo AlphaGo, la primera IA en derrotar a un campeon mundial en Go, y alimenta sistemas de control robotico, IA para juegos y algoritmos de recomendacion.

El aprendizaje por refuerzo es el paradigma mas complejo y requiere funciones de recompensa cuidadosamente disenadas. Sobresale en problemas de toma de decisiones secuenciales donde el resultado a largo plazo importa mas que cualquier accion individual.

Como Funcionan los Modelos de Machine Learning

Los modelos tradicionales de machine learning siguen un flujo de trabajo consistente:

Ingenieria de features. Los humanos identifican y extraen las features (variables) relevantes de los datos brutos. Para un modelo de precio inmobiliario, las features podrian incluir metros cuadrados, codigo postal, ano de construccion y numero de banos. La ingenieria de features es frecuentemente el paso mas importante y que mas tiempo consume en el machine learning tradicional — la calidad de las features determina en gran medida la calidad de las predicciones.

Entrenamiento del modelo. El algoritmo procesa los datos de entrenamiento y ajusta sus parametros internos para minimizar errores de prediccion. Un arbol de decision aprende que features separan mejor los datos. Una regresion lineal encuentra la linea de mejor ajuste. Un bosque aleatorio construye cientos de arboles de decision y promedia sus predicciones.

Evaluacion. El modelo se prueba con datos que no ha visto antes para medir su exactitud, precision, recall y otras metricas. Si el rendimiento es insuficiente, los ingenieros ajustan features, prueban diferentes algoritmos o ajustan hiperparametros.

Despliegue. El modelo entrenado se integra en una aplicacion donde procesa nuevos datos y genera predicciones en tiempo real.

Fortalezas del Machine Learning Tradicional

El ML tradicional tiene ventajas importantes que lo mantienen dominante para muchas aplicaciones:

Interpretabilidad. Frecuentemente puedes entender por que un modelo de ML tradicional hizo una prediccion especifica. Un arbol de decision muestra exactamente que features y umbrales llevaron a una decision. Una regresion lineal asigna pesos claros a cada feature. Esta interpretabilidad es critica en industrias reguladas como salud, finanzas y seguros donde las decisiones deben ser explicables.

Eficiencia de datos. Los algoritmos tradicionales de ML pueden aprender efectivamente de cientos o miles de ejemplos. No necesitas millones de puntos de datos para construir un modelo util. Para muchos problemas del mundo real, los datos etiquetados son escasos y costosos de crear.

Eficiencia computacional. Los modelos tradicionales de ML se entrenan en minutos u horas en hardware estandar. No requieren clusters costosos de GPU o semanas de tiempo de entrenamiento. Esto los hace practicos para equipos pequenos con presupuestos limitados.

Confiabilidad. Los sistemas de ML tradicional bien disenados son estables y predecibles. No alucinan ni generan salidas inesperadas. Para muchas aplicaciones de negocio, predicciones confiables y explicables son mas valiosas que una exactitud marginalmente mayor.

Deep Learning: Redes Neuronales a Escala

Que Es Deep Learning

Deep learning es machine learning usando redes neuronales artificiales con multiples capas — "deep" (profundo) refiriendose al numero de capas en la red. Estas redes aprenden representaciones jerarquicas de los datos, descubriendo automaticamente las features que importan en lugar de depender de features disenadas por humanos.

Una red neuronal profunda para reconocimiento de imagenes podria aprender a detectar bordes en su primera capa, formas simples en la segunda, formas complejas en la tercera y objetos completos en capas mas profundas. La red construye representaciones cada vez mas abstractas y sofisticadas a medida que los datos fluyen a traves de las capas.

Este aprendizaje automatico de features es la ventaja clave del deep learning. En lugar de requerir expertos humanos para identificar y extraer features relevantes de datos brutos, los modelos de deep learning aprenden features optimas directamente de los datos. Para datos complejos y de alta dimensionalidad como imagenes, audio y lenguaje natural, este enfoque automatizado supera dramaticamente la ingenieria manual de features.

Como Funcionan las Redes Neuronales

Una red neuronal esta compuesta de capas de nodos (neuronas) interconectados, vagamente inspirados en las neuronas biologicas del cerebro humano.

Capa de entrada. Los datos brutos entran en la red — pixeles de una imagen, palabras de una oracion o features numericas de un conjunto de datos.

Capas ocultas. Los datos pasan a traves de una o mas capas intermedias donde ocurren transformaciones. Cada neurona recibe entradas de la capa anterior, aplica una funcion matematica (llamada funcion de activacion) y pasa el resultado a la siguiente capa. Las conexiones entre neuronas tienen pesos que se ajustan durante el entrenamiento.

Capa de salida. La capa final produce la prediccion de la red — una etiqueta de clasificacion, una probabilidad, un token generado o un valor numerico.

Entrenamiento (retropropagacion). Cuando la red comete un error de prediccion, la senal de error se propaga hacia atras a traves de la red, y los pesos de las conexiones se ajustan para reducir errores futuros. Este proceso, repetido millones o miles de millones de veces en los datos de entrenamiento, mejora gradualmente la exactitud de la red.

Tipos de Arquitecturas de Deep Learning

Diferentes arquitecturas de redes neuronales estan optimizadas para diferentes tipos de datos y tareas.

Redes Neuronales Convolucionales (CNNs) estan disenadas para datos estructurados en cuadricula como imagenes. Las capas convolucionales aplican filtros que detectan patrones locales — bordes, texturas, formas — y las capas de pooling reducen progresivamente las dimensiones espaciales. Las CNNs dominan clasificacion de imagenes, deteccion de objetos, imagenologia medica y conduccion autonoma.

Redes Neuronales Recurrentes (RNNs) y LSTMs fueron disenadas para datos secuenciales como texto y series temporales. Mantienen una memoria de entradas anteriores, permitiendo procesar secuencias de longitud variable. Aunque ampliamente superadas por transformers para tareas de lenguaje, las RNNs siguen siendo utiles para algunas aplicaciones de series temporales.

Transformers usan mecanismos de atencion para procesar todos los elementos de una entrada simultaneamente, capturando dependencias de largo alcance con las que las RNNs tienen dificultad. Los transformers son la base de todos los grandes modelos de lenguaje modernos y se aplican cada vez mas a vision, audio y otros dominios.

Redes Generativas Adversariales (GANs) consisten en dos redes compitiendo — un generador que crea datos y un discriminador que intenta distinguir datos generados de datos reales. Este entrenamiento adversarial produce contenido generado notablemente realista.

Fortalezas del Deep Learning

Rendimiento superior en datos complejos. Para imagenes, audio, video y lenguaje natural, deep learning supera dramaticamente al ML tradicional. La capacidad de aprender features automaticamente de datos brutos elimina el cuello de botella de la ingenieria manual de features y frecuentemente descubre patrones que los ingenieros humanos nunca identificarian.

Escalabilidad. El rendimiento del deep learning generalmente mejora con mas datos y mas poder computacional. Este comportamiento de escalado — mas datos equivalen a mejores resultados — es una ventaja fundamental para organizaciones con acceso a grandes conjuntos de datos.

Transfer learning. Los modelos entrenados en una tarea pueden ajustarse para tareas relacionadas, reduciendo dramaticamente los datos y el computo necesarios para nuevas aplicaciones. Un modelo de vision entrenado en millones de imagenes genericas puede ajustarse con solo cientos de imagenes medicas especificas para detectar condiciones especificas.

Aprendizaje de extremo a extremo. Los sistemas de deep learning pueden aprender a mapear entradas brutas directamente a salidas deseadas sin pasos intermedios. Un sistema de subtitulado de imagenes puede aprender a ir directamente de pixeles a descripciones en lenguaje natural sin etapas separadas de deteccion de objetos, analisis de escena y generacion de oraciones.

Machine Learning vs Deep Learning: Las Diferencias Clave

Requisitos de Datos

El ML tradicional funciona bien con cientos a miles de puntos de datos. Deep learning tipicamente requiere decenas de miles a millones de ejemplos para entrenarse efectivamente. Si tu conjunto de datos es pequeno, ML tradicional generalmente es la mejor opcion. Si tienes cantidades masivas de datos, deep learning puede explotarlos mas efectivamente.

Ingenieria de Features

El ML tradicional requiere que los humanos identifiquen y diseyen las features correctas — un proceso que demanda experiencia en el dominio y esfuerzo significativo. Deep learning aprende features automaticamente de datos brutos. Para problemas donde las features correctas son obvias (datos tabulares con columnas claras), la ingenieria manual funciona bien. Para problemas donde las features no son obvias (que features de una imagen indican "gato"?), el aprendizaje automatico gana.

Costo Computacional

Entrenar un modelo de ML tradicional requiere recursos computacionales modestos — una laptop puede manejar muchas tareas. Entrenar un modelo de deep learning, especialmente uno grande, requiere GPUs o TPUs poderosas, frecuentemente durante dias o semanas, a costos que pueden alcanzar millones de dolares para los modelos mas grandes. Esta diferencia de costo influye en que enfoque es practico para una organizacion y problema determinado.

Interpretabilidad

Los modelos tradicionales de ML, particularmente arboles de decision y modelos lineales, proporcionan explicaciones claras para sus predicciones. Los modelos de deep learning son en gran medida cajas negras — logran resultados excelentes pero ofrecen poca vision sobre por que hicieron una prediccion especifica. En contextos donde la explicabilidad es legal o eticamente requerida, esta diferencia puede ser decisiva.

Techo de Rendimiento

Para datos estructurados y tabulares (hojas de calculo, bases de datos, registros financieros), los metodos tradicionales de ML — particularmente algoritmos de gradient boosting como XGBoost y LightGBM — siguen siendo competitivos o superiores al deep learning. Multiples competencias Kaggle han demostrado que gradient boosting supera al deep learning en datos tabulares mas frecuentemente que no.

Para datos no estructurados (imagenes, texto, audio, video), deep learning es claramente superior. La brecha de rendimiento es tan grande que el ML tradicional raramente se considera siquiera para estas tareas.

Cuando Usar Machine Learning vs Deep Learning

Elige Machine Learning Tradicional Cuando

- Tu conjunto de datos es pequeno (menos de 10,000 ejemplos)

- Tus datos son tabulares y estructurados

- Necesitas predicciones interpretables y explicables

- Tienes recursos computacionales limitados

- La velocidad de entrenamiento y despliegue importa

- Expertos del dominio pueden identificar las features relevantes

- Necesitas predicciones confiables y estables en produccion

Ejemplos del mundo real: Puntaje crediticio, deteccion de fraude, prediccion de abandono de clientes, pronostico de demanda de inventario, diagnostico medico a partir de datos estructurados de pacientes, evaluacion de riesgo de seguros.

Elige Deep Learning Cuando

- Tienes grandes cantidades de datos (100,000+ ejemplos)

- Tus datos son no estructurados (imagenes, texto, audio, video)

- La exactitud maxima es mas importante que la interpretabilidad

- Tienes acceso a GPUs o computacion en la nube

- El problema involucra reconocimiento de patrones en datos complejos

- La ingenieria de features seria impractica o imposible

- Puedes aprovechar modelos preentrenados a traves de transfer learning

Ejemplos del mundo real: Clasificacion de imagenes y deteccion de objetos, procesamiento y generacion de lenguaje natural, reconocimiento de voz, conduccion autonoma, analisis de imagenes medicas, sistemas de recomendacion a escala.

El Enfoque Hibrido

En la practica, muchos sistemas de IA en produccion combinan ambos enfoques. Un motor de recomendacion podria usar deep learning para extraer features de imagenes y descripciones de productos pero gradient boosting para hacer la recomendacion final basada en datos de comportamiento del usuario. Un sistema de deteccion de fraude podria usar una red neuronal para analizar patrones de transaccion pero un sistema basado en reglas para firmas conocidas de fraude.

Los mejores profesionales eligen el enfoque mas simple que logre el rendimiento requerido. Comenzar con ML tradicional y pasar a deep learning solo cuando el problema lo exige es una buena practica de ingenieria.

El Futuro: Convergencia y Nuevas Fronteras

La frontera entre machine learning y deep learning se esta volviendo cada vez mas difusa. Varias tendencias estan reformando el panorama.

Modelos de fundacion — grandes modelos preentrenados en vastos conjuntos de datos — estan habilitando capacidades de deep learning con datos minimos. Ajustar un modelo preentrenado requiere muchos menos ejemplos que entrenar desde cero, reduciendo la ventaja de datos que el ML tradicional tenia para conjuntos de datos pequenos.

AutoML y busqueda de arquitectura neuronal automatizan gran parte de la experiencia previamente necesaria para deep learning. Herramientas como AutoML de Google, Auto-sklearn y FLAML pueden seleccionar y ajustar modelos automaticamente, reduciendo la barrera tecnica de entrada.

Arquitecturas eficientes estan reduciendo el costo computacional del deep learning. Tecnicas como destilacion de conocimiento, poda y cuantizacion hacen posible ejecutar redes neuronales sofisticadas en telefonos moviles y dispositivos de borde.

Deep learning tabular es un area activa de investigacion. Aunque gradient boosting aun lidera en la mayoria de los benchmarks tabulares, modelos como TabNet, FT-Transformer y varios enfoques hibridos estan reduciendo la brecha. El futuro podria ver al deep learning volverse competitivo en todos los tipos de datos.

IA neuro-simbolica combina redes neuronales con razonamiento simbolico — el enfoque basado en reglas que precedio al machine learning. Estos sistemas hibridos buscan combinar el reconocimiento de patrones del deep learning con el razonamiento logico y la interpretabilidad de la IA clasica.

Conclusion

Machine learning y deep learning no son enfoques competidores — son herramientas complementarias en el kit de herramientas de IA. Machine learning proporciona soluciones confiables, interpretables y eficientes para problemas de datos estructurados. Deep learning entrega rendimiento revolucionario en datos complejos y no estructurados donde la ingenieria manual de features es impractica.

La eleccion correcta depende de tu problema especifico: cuantos datos tienes, que tipo de datos son, si necesitas explicabilidad, que recursos computacionales estan disponibles y que nivel de exactitud se requiere.

Entender ambos enfoques — sus fortalezas, limitaciones y casos de uso apropiados — es conocimiento esencial para cualquier persona que trabaje con IA en 2026. El campo se mueve rapido, pero los principios fundamentales que distinguen machine learning de deep learning siguen siendo relevantes y continuaran guiando decisiones practicas de IA por anos.

Los profesionales de IA mas efectivos no son leales a un enfoque sobre otro. Entienden todo el espectro de tecnicas, desde regresion lineal simple hasta transformers con miles de millones de parametros, y eligen la herramienta correcta para cada problema. Esa mentalidad pragmatica, enfocada en el problema, vale mas que cualquier algoritmo individual.